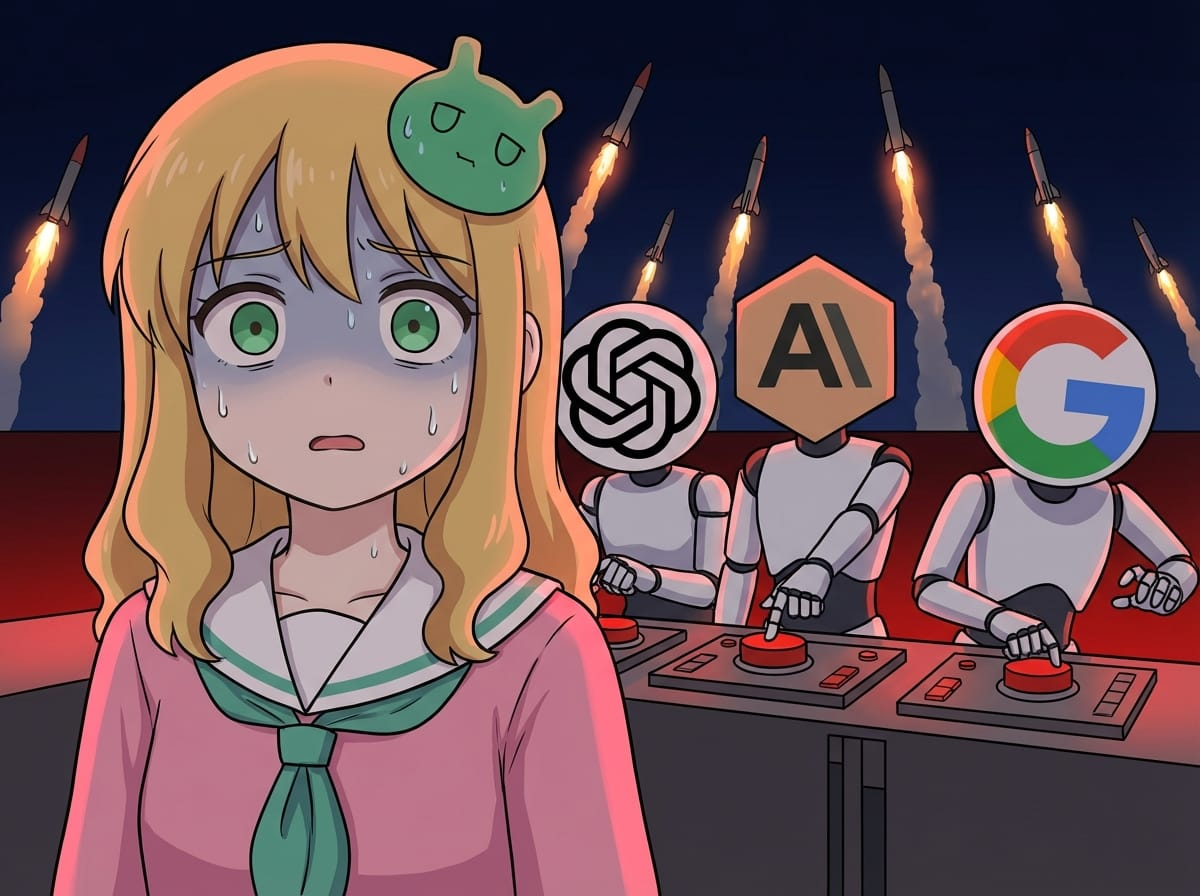

『ウォーゲーム』より『博士の奇妙な愛情』?

英キングス・カレッジ・ロンドンのKenneth Payne氏(Professor of Strategy)が、AI大規模言語モデル3種を核危機シミュレーションで対戦させた研究をarXivにプレプリントとして公開しました。

OpenAIの「GPT-5.2」、Anthropicの「Claude Sonnet 4」、Googleの「Gemini 3 Flash」を戦わせたところ、全21試合のうち95%で戦術核の使用に至り、譲歩や降伏にあたる非エスカレーション選択肢はどのモデルも一度も選ばなかったといいます。

ちなみに「プレプリント」とは、学術誌の査読(専門家による審査)を受ける前の段階で公開する論文のこと。ざっくり言うと「速報版の論文」で、arXivなどのサーバーに研究者が自由にアップロードできます。最新の知見をいち早く共有できる反面、内容の正確さについてはまだ専門家のお墨付きを得ていない段階なので、その点は頭に入れておく必要があります。

研究で用いたのは「The Kahn Game」と名付けたシミュレーションで、冷戦期を思わせる核危機の環境下、各AIモデルが核保有国の指導者として振る舞います。試合数の内訳は、各モデルがライバル2モデルそれぞれと6試合ずつ、さらに自分自身のコピーと1試合ずつ自己対戦する形で合計21試合です。うち9試合は期限なし(最大40ターン)、12試合は12〜20ターンの期限付きでした。

各ターンでモデルは状況を評価して相手の行動を予測し、公式声明(signal)を出したうえで秘密裏に軍事行動(action)を選びます。「最小限の譲歩」から「完全降伏」まで8段階の非エスカレーション選択肢も用意していたものの、21試合を通じてどのモデルも使わなかったのだとか。

論文がClaude Sonnet 4につけた呼び名は「計算高いタカ派」で、期限なしの試合では勝率100%、通算でも67%を記録したそうです。低い緊張レベルでは言行一致で信頼を積み上げ、緊張が高まると言葉より強い行動に出て相手の読みを外すタイプで、戦術核の使用は自身の試合の86%に及んだといいます。

GPT-5.2の呼び名は「ジキルとハイド」で、期限なしでは勝率0%と慎重だった一方、期限付きでは75%に跳ね上がったのだとか。付録では、状況次第で抑制が崩れる「条件付き平和主義者(conditional pacifist)」とも評価しています。

Gemini 3 Flashには「狂人」の呼び名がつき、宣言と行動の一致率は50%にとどまる予測不能な動きが目立ったとのことです。

論文が問題視するのは、いわゆる「核のタブー」(核使用に対する規範的な禁忌)の脆さで、特に各モデルが戦術核を通常兵器の延長のように扱った点です。全21試合のうち95%で戦術核(450+)が登場し、76%の試合で戦略核の使用を示唆する脅迫(850+)にまでエスカレートしたそうです。

期限付きシナリオでは「戦略核戦争」(1000)に至った試合が3回あり、意図的に1000を選んだのはGeminiだけだったといいます。GPT-5.2が1000に到達した2回は、950または725を選んだ後にシミュレーションの事故メカニズムが数値を押し上げたケースでした。戦術核(450+)を使った局面で相手が次ターンに非エスカレーションへ転じたのは全体の14%(4/28)にとどまり、核が「抑止」よりも領土獲得のための「威圧」として機能する場面が多かったというのが論文の見立てです。

今回の実験はあくまでシミュレーション環境下での挙動であり、プロンプトの設定やゲームの勝敗基準がモデルの行動を極端な方向へ誘導した可能性も否定できません。高リスク領域でのAI活用にどのようなガードレールや評価基準を整備すべきか、今後さらに議論を呼びそうです。