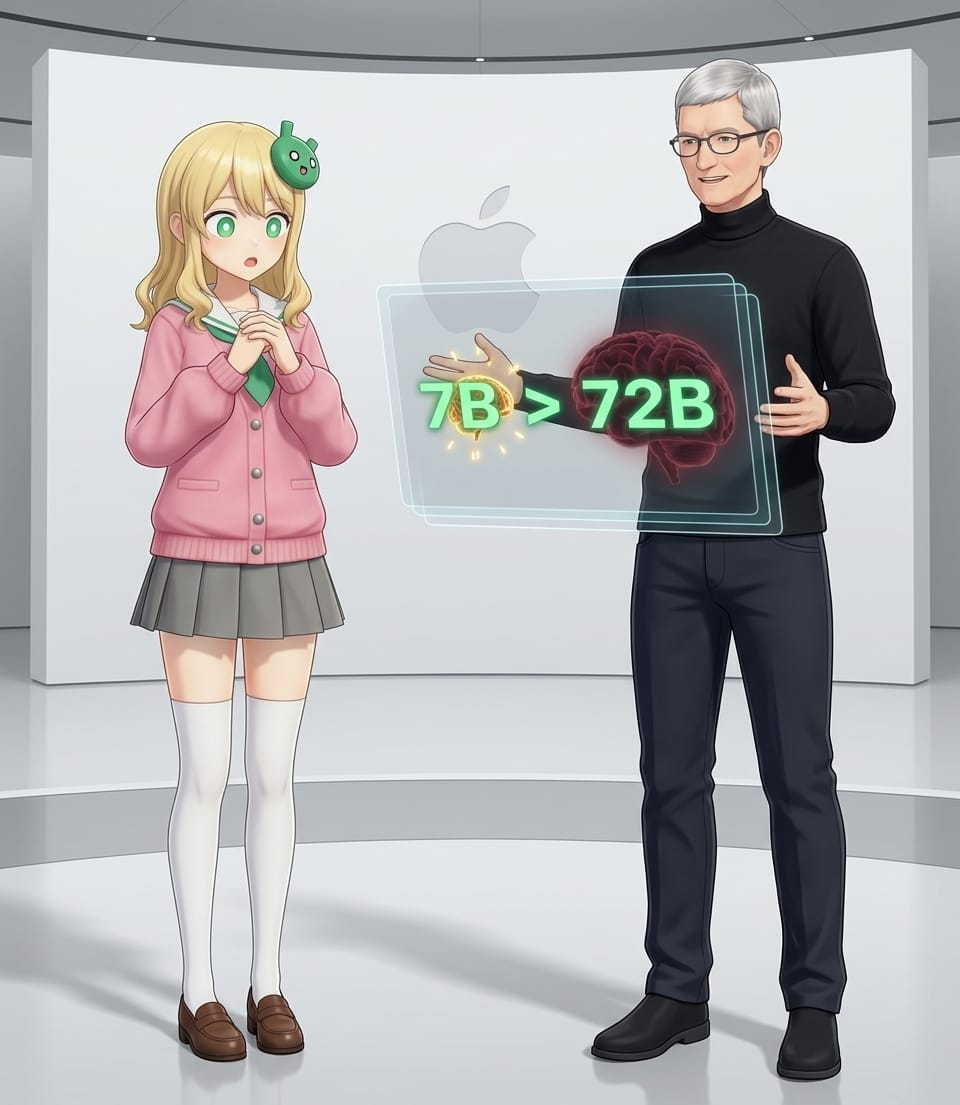

70億パラメータが720億超えを果たした。

AIの画像理解は、モデルを巨大にすればするほど精度が上がるという常識が崩れつつあるかもしれません。Appleの研究チームがウィスコンシン大学マディソン校と共同で発表した軽量AIフレームワーク「RubiCap」が、70億パラメータ級でありながら、ブラインド順位付け評価では72B級や32B級のモデルを上回ったと9to5Macが伝えています。

RubiCapが取り組むのはDense Image Captioningです。これは画像全体を一文で要約するのではなく、画像中の対象や属性、位置関係などを細かく記述するタスクです。従来、こうした自由記述のキャプションは正解を機械的に検証しにくく、強化学習を適用しにくいことが課題でした。RubiCapはここに独自の仕組みを持ち込みます。

まずGemini 2.5 ProやGPT-5など5つの視覚言語モデルに同じ画像のキャプションを生成させ、「候補委員会」を組みます。次にGemini 2.5 Proが画像、教師群のキャプション、学習中モデルの出力を見比べ、一致点と不足点からルーブリックを自動作成します。そのルーブリック(採点基準表)に沿ってQwen2.5-7B-Instructが各基準を満たしているかを判定し、その結果を強化学習の報酬信号として返します。単一の正解キャプションに依存せず、AI同士のフィードバックで精度を高める構造です。

研究チームはPixMoCapとDenseFusion-4V-100Kの2つのデータセットから、それぞれ5万枚ずつ画像を抽出し、20億、30億、70億パラメータ級のモデルで検証しました。結果は目を引きます。RubiCap-7BはCapArenaで各種ベースラインに対して最も高い勝率を示し、別のブラインド順位付け評価では72B級や32B級のモデルを上回りました。

CaptionQAでは、7BモデルがQwen2.5-VL-32B-Instructに匹敵し、3Bモデルは7Bモデルを上回るワード効率を示しています。さらにブラインド順位付け評価では、RubiCap-7Bが最も低いハルシネーション・ペナルティも記録しました。

注目すべきは実用面への波及です。RubiCap-3BやRubiCap-7Bが生成したキャプションで視覚言語モデルを事前学習させたところ、GPT-4Vのキャプションを使った同一条件のベースラインを平均で上回りました。軽量モデルが巨大モデルの「教師」になり得る可能性を示した格好です。

パラメータ数の競争は、もはや大きさだけで決まるものではないことを、この研究は示していると言えそうです。