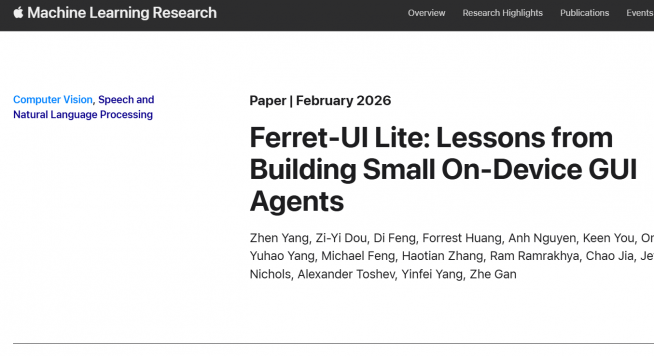

Appleの研究チームが、デバイス上で動作しアプリの画面を自律的に操作するAIエージェント「Ferret-UI Lite」を開発したと、9to5Macが伝えました。

Ferret-UI Liteは、Appleが2023年12月以降に段階的に発表してきた「Ferret」シリーズの流れをくむ最新の研究モデル。初代Ferretは、画像内の特定領域を自然言語で参照し、その場所を特定する能力を狙ったマルチモーダル大規模言語モデル(MLLM)として紹介されています。

なおFerret-UIはモバイルUI理解に特化し、縦長画面や小さなUI要素を扱うために「any resolution」を取り入れて細部を見やすくしています。Ferret-UI 2はiPhone/Android/iPad/Webpage/AppleTVなど複数プラットフォーム対応や、高解像度の認識強化(adaptive scaling)などを指向しています。

今回のFerret-UI Liteは、30億パラメータの小さなモデルとしてオンデバイス動作を強く意識した研究だそうです。従来のGUIエージェント研究は大規模なサーバー側モデルに寄りがちで、推論や計画は強い一方、計算資源や通信、プライバシー面の扱いが課題になりやすいと論文側は述べています。9to5Macも、ローカルで動くことでクラウド送信を前提としない分、プライバシー面で利点があると紹介しています。

技術面では、実データと合成データを組み合わせた多様なGUIデータで学習している点が特徴だそうです。特に合成データについては、ライブのGUI環境に直接触れてロールアウトを生成するマルチエージェント構成を使っており、難易度を段階的に上げるタスク生成器、手順を分解する計画エージェント、画面上で操作するグラウンディングエージェント、結果を評価する批評モデルが連携するとされています。

推論時には、画面の注目領域をその場で切り出して拡大する「cropping/zoom-in」を使うそうです。まず全体で初期予測を出し、その近傍をクロップして再予測する2段階で、小型モデルの視覚トークン処理量の限界を補う狙いだといいます。学習も教師あり微調整に加えて、報酬設計を伴う強化学習(RLVR)を適用しているとのことです。

ベンチマークではGUIグラウンディングでScreenSpot-V2が91.6%、ScreenSpot-Proが53.3%とされています。GUI操作(ナビゲーション)のタスク成功率はAndroidWorldで28.0%、OSWorldで19.8%で、論文本文ではOSWorldの19.8%は最大ステップ数を50に延ばした設定で得た値だと説明されています。

短いステップで完了する単純なタスクでは比較的うまく動く一方、複数ステップにまたがる複雑な操作では伸び悩む傾向があるとも。小型モデルゆえの限界は、この分野全体の課題のようです。

また9to5Macは、Ferret-UI LiteがAndroidWorldやOSWorldなどを使い、Android、ウェブ、デスクトップ系のGUI環境で学習・評価している点を「興味深い」としています。なお、Ferret-UI側の論文ではテストにAndroidも含めているため、過去作が完全にiPhoneだけというわけではなさそうです。

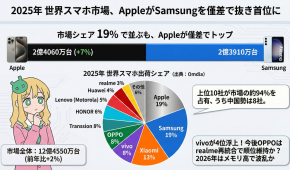

SamsungもOne UI 8.5でBixbyをより会話型の「デバイスエージェント」として強化するなど、端末操作のAI体験を拡充しており、Appleとの勝負となりそうです。

Ferret-UI Liteはあくまで研究段階のモデルで、現時点でSiriやApple Intelligenceに組み込まれると決まったわけではないようです。ただ「端末内で完結しうるGUIエージェント」を小型モデルで成立させようとしている点は、今後の方向性を占う材料にはなりそうです。