もう、ウィジェットは話して作るらしい。

スマホのウィジェット、自分の言葉だけで作れるようになるみたいです。Googleは2026年5月12日に開催したオンラインイベント「Android Show: I/O Edition」で、Gemini IntelligenceをAndroid全体に深く組み込む一連の機能を発表しました。

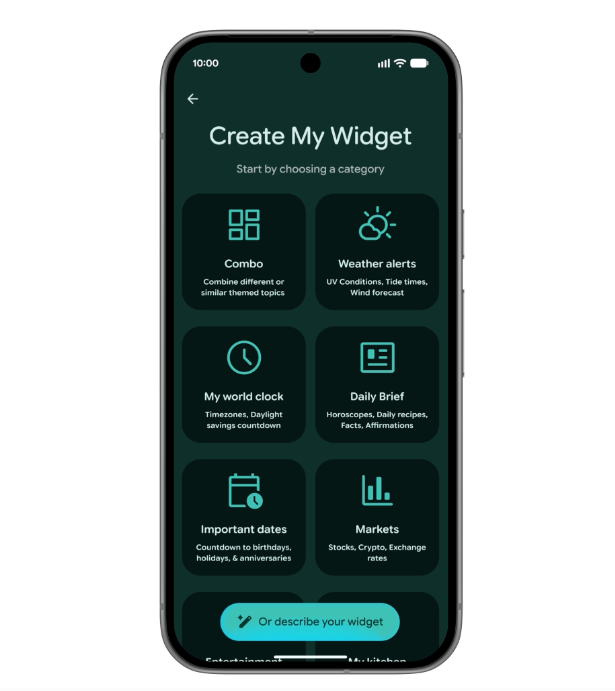

目玉は「Create My Widget」。プログラミング不要、自然言語で指示するだけでホーム画面ウィジェットが生成できる、いわゆるバイブ・コーディング(雰囲気でコードを書く感覚)の発想を取り入れた機能です。

たとえば「高タンパクなミールプレップのレシピを毎週3つ提案して」と頼むだけで、専用ダッシュボードがホーム画面に並ぶ。サイズ変更も自在で、Wear OSのタイルやウィジェット向けにも最適化されるそうです。スマホやスマートウォッチの情報表示を言葉で整えられるのは、地味に嬉しい進化ですね。

もう一つの主役がエージェント型AI(複数アプリをまたいで作業を肩代わりするAI)。電源ボタン長押しから音声で指示すると、メモアプリの買い物リストをショッピングアプリのカートに移したり、スピンクラスの予約を取ったり、Gmail内のシラバスを調べて必要な書籍をカートに入れたりといった多段階タスクをこなすといいます。なお、決済など機微な操作の直前ではきちんと止まり、ユーザーの最終承認を待つ仕様。勝手に走らないよう、ブレーキも用意してあるってことなんでしょう。

ほかにもAndroid版「Gemini in Chrome」が6月後半から、米国の対象端末向けに順次提供開始。GboardにはAI音声入力「Rambler」(話し言葉のフィラーを除去して整える機能)や、Personal Intelligenceと連携した自動フォーム入力(オプトイン方式)も加わります。

ロールアウトは2026年夏から。まずは最新のSamsung GalaxyおよびGoogle Pixelスマートフォンから順次展開し、今年後半にはスマートウォッチ、車、グラス、ノートPCなどのAndroid関連デバイスへ広げていく予定です。日本での提供有無や具体的な地域は、今後発表されるといいます。

アプリの集合体だったスマホが、OS全体で考えるレイヤーに変わる……。バイブ・コーディングという軽い言葉の裏で、スマホとの付き合い方が静かに書き換えられていく……はず!