Googleが米国防総省(戦争省、ペンタゴン)との既存AI契約を修正し、生成AI「Gemini」を機密環境でも利用できるようにしたと、The Informationを基にReutersやThe Vergeなどが報じています。

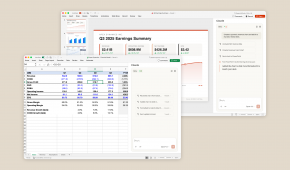

Gemini軍事利用の契約上の用途は「あらゆる適法な政府目的」とされ、かなり広い表現になっています。なお、2025年に米国防総省のCDAOがGoogle、Anthropic、OpenAI、xAIに付与した契約枠は、各社最大2億ドルでした。

この報道の前日となる2026年4月27日には、Googleの従業員600人以上がCEOのスンダー・ピチャイ氏に対し、機密の軍事AI業務を拒否するよう求める書簡に署名していました。報道によると、署名者にはGoogle DeepMindの研究者や、ディレクター、ヴァイスプレジデント級を含む幹部級社員も含まれていたとされています。

書簡では、AIが人類のために使われることを望んでいるとしたうえで、非人道的、あるいは極めて有害な使われ方を見たくないと訴えています。懸念の例として挙げられているのは、致死性の自律兵器や大規模監視です。

今回の契約には、国内の大規模監視や、標的選定を含む自律兵器について、適切な人間の監督と管理なしに使うべきではないという制限が盛り込まれていると伝えられています。一方で、政府の要請があればGoogleは安全設定やフィルターの調整を支援する必要があり、合法的な軍事運用上の判断に対してGoogle側が拒否権を持つわけではないとも報じられています。

社員側が問題視しているのは、機密ネットワークが外部インターネットから隔離された環境で運用される点です。そうした環境では、Googleが通常の方法で利用実態を把握できる範囲は大きく限られます。つまり、安全条項を設けたとしても、その実効性を外部から検証しにくいという懸念があります。

Googleには前例もあります。2018年には、AIでドローン映像を解析する米軍プロジェクト「Project Maven」をめぐって社員の大規模な抗議が起き、Googleは契約を更新しませんでした。しかし2025年2月、GoogleはAI原則を改定し、従来掲げていた「兵器」や「監視」目的のAIを追求しないという明示的な文言を削除しています。今回の契約は、その方針転換の延長線上にあると見ることもできます。

なお、ライバルのAnthropicは、自律兵器や大規模な国内監視に関する安全措置を緩めることを拒んだ結果、最大2億ドル規模の国防総省契約をめぐって対立、供給網リスクに指定もされました。