AIがアプリを「代わりに触る」時代の幕開け。

「AIアシスタントがアプリを代わりに操作してくれる」。夢みたいな未来が具体的に形になり始めました。Googleは2月25日、Geminiアプリにマルチステップのタスク自動化機能をベータ提供すると発表しました。対応デバイスはSamsung Galaxy S26シリーズとPixel 10/Pixel 10 Pro/Pixel 10 Pro XLです。両機種、米国から展開します。

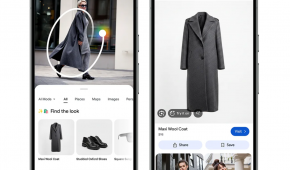

仕組みはこうです。ユーザーが電源ボタンを長押ししてGeminiを起動し、「空港までの配車を頼んで」とプロンプトを投げる。するとGeminiは端末上の「安全な仮想ウィンドウ」でアプリを立ち上げ、目的地の入力、車種の選択、配車時刻の設定などを進めていきます。仮想画面上の処理はクラウド側で行われ、仮想ウィンドウは端末内のほかのデータには触れない設計です。ユーザーはGeminiがスクロールし、タップし、テキストを入力する様子をリアルタイムで眺めることも、バックグラウンドに回して別のアプリを使い続けることもできます。

注目すべきは「最後のボタンは人間が押す」という設計思想でしょう。購入や注文、配車依頼の最終確定では、Geminiはユーザーにアプリを開いて最後の操作を自分で行うよう促します。操作中は「Working on this task」という通知が表示され、「進捗を見る」「タスクを停止する」「自分で操作する」といった選択肢が示されます。全自動に見えて、手綱は握らせてくれる。

ベータ段階で対応するアプリは、ライドシェア・フードデリバリー・食料品の3カテゴリの一部に限られています。Google公式は全件リストを明示していませんが、少なくとも現時点ではLyft、Uber、Grubhub、DoorDash、Uber Eats、Starbucksが確認されています。Galaxy S26シリーズでは発売日の3月11日から利用可能になり、Pixel 10シリーズには3月中に順次配信されます。

The Vergeの実機テストでは、Uberでの空港への配車準備やStarbucksでのコーヒーとクロワッサンの注文準備が正しく進んだそうです。クロワッサンを温めるかどうかという細かいカスタマイズの判断まで処理したとのことで、単純なタップの自動化ではなく、文脈を踏まえた操作が実現しつつあることを示しています。

もちろん、課題は山積みです。対応アプリはまだ限定的で、地域も米国と韓国のみ。ベータである以上、予期しない挙動も起こり得ます。しかしGoogleが見せているのは、AIエージェントがアプリのUIを実際に操作する方向性です。今後の対応範囲拡大に期待です。