自宅のGPUマシンがどこでも使えるAIサーバーに?

VPNサービスのTailscaleとローカルLLM実行アプリのLM Studioが連携し、新機能「LM Link」を発表しました。Tailscaleの公式ブログが2月25日に伝えています。LM Linkを使えば、自宅や職場の高性能マシンで動くLLMに、外出先のノートPCからローカル環境と同じ感覚でアクセスできるとのことです。

LM Linkの基盤は、LM Studioに組み込んだTailscaleのライブラリ「tsnet」です。ユーザースペースで動く仕組みのため、OSカーネルのソケットやルーティングテーブルには触れません。デバイス同士を認証すれば、ネットワーク環境を問わずエンドツーエンドの暗号化接続を自動で確立します。

TailscaleのメッシュVPN(WireGuardベース)上で動作するため、プロンプトや推論結果、モデル一覧、ハードウェア情報といったやり取りはTailscaleやLM Studioのバックエンドからも見えない仕組みだといいます。ただし、デバイス同士を発見するためのデバイス一覧など一部メタデータはLM Studio側に送る仕組みだそうです。

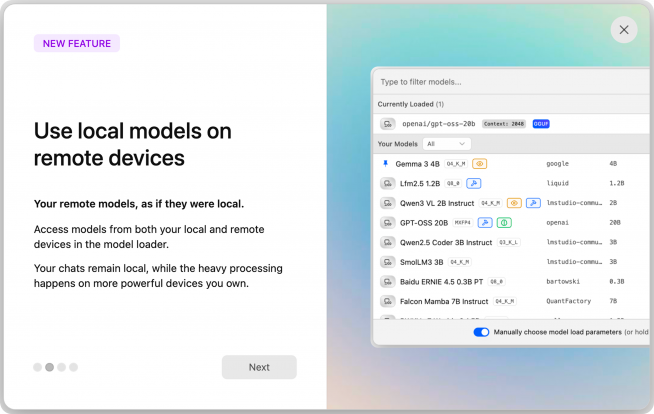

LM Studioのデスクトップアプリでは「Add a remote machine」(リモート端末の追加に相当)から数クリックで初期設定が完了します。ターミナルからも「lms login」で案内に従ってログインし、「lms link enable」を実行するだけで利用を始められます。公開インターネットへのポート開放や手動のポートフォワーディングは不要で、端末間の通信はすべて暗号化されるとしています。

Tailscaleが活用例として挙げるのは、個人開発者が自宅のGPU搭載マシン上のLLMをノートPCから呼び出す使い方や、チーム内でGPU上の大規模モデルを複数メンバーで共有する運用です。CI/CDパイプラインからのテスト呼び出しや、規制産業でのオンプレミス運用にも適するそうです。

対応OSはmacOS、Windows、Linuxで、手元の端末に加えクラウドVMでも動作します。料金は最大2ユーザー、ユーザーあたり5台(合計10台)まで無料です。LM Linkは現在プレビュー段階で、アクセスを段階的に開放しているそうです。LM Studio自体は個人・業務ともに無料で利用でき、企業向けにはEnterpriseプランも用意。追加ユーザーやデバイスへの課金はプレビュー終了後に導入する見込みだといいます。